Fuente: El Mostrador

Encendemos la televisión y escuchamos las noticias habituales: guerra, pandemia y cambio climático. De repente, una noticia científica: la inteligencia artificial (IA) ha ayudado a resolver algún problema clave de la humanidad.

“La IA”. Así de simple. Como si se tratara de un ente consciente con el que podemos tomar café, nos comprende y discutimos de conceptos abstractos. No, no estamos ahí (todavía), a pesar de los esfuerzos de las grandes empresas por hacernos creer que el coche autónomo o las máquinas sintientes están a la vuelta de la esquina.

En la última década los métodos automáticos basados en IA han mejorado enormemente. El aumento de la capacidad computacional, junto con las mejoras algorítmicas, han dado lugar a una revolución tecnológica.

Ahora tenemos sistemas automáticos de reconocimiento y traducción del habla en el móvil, de traducción de textos manuscritos en Google y DeepL, avatares que resuelven dudas legales y políticas, y que ayudan al diagnóstico clínico, etiquetan personas y objetos en fotografías, predicen el tiempo a partir de imágenes de satélites, nos dan recomendaciones sobre qué ver y qué comprar en Netflix o Amazon, e incluso generan imágenes y vídeos ficticios, pero muy realistas.

La IA está cada vez más integrada en nuestras vidas, casi sin darnos cuenta, y lo estará cada vez más. No se trata de robots de película. La IA es menos visible, pero ubicua.

Científicos como Geoffrey Hinton, galardonado con el Premio Turing, se han atrevido a vaticinar que el deep learning (aprendizaje profundo), una técnica matemática de IA, lo va a resolver todo. Sí, sí: todo.

¿Pero es esto así?

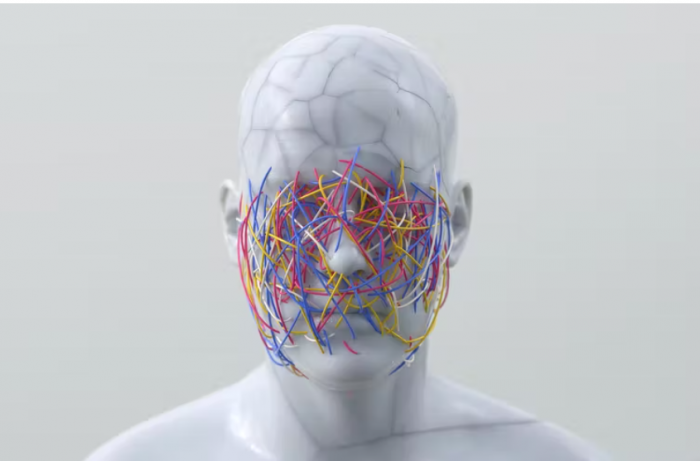

La IA está resolviendo muchos problemas de predicción, pero hay muy poca evidencia de su poder de comprensión y abstracción. ¿Es inteligente la inteligencia artificial? En los últimos años nos hemos dado cuenta de que la IA, en realidad, no es muy interpretable, ni explicable, ni respeta las leyes fundamentales de la física, ni sabe de causalidad, abstracción, justicia o ética.

Peligroso, ¿no?

Queremos entender, no solo predecir

Los modelos basados en aprendizaje profundo han sido entrenados para predecir con gran precisión, y en la actualidad tienen tantos parámetros y son tan complejos que sus decisiones a menudo son imposibles de explicar a un humano.

Por ejemplo, aunque la IA se ha usado para ayudar en distintos aspectos de la covid-19, a día de hoy no se ha conseguido ningún resultado tangible y usado por la práctica médica. La razón es casi siempre la misma: falta de fiabilidad, robustez y escrutinio.

Poco a poco eso está cambiando. Existen muchas iniciativas, tanto técnicas como normativas y legislativas, para asegurar una IA fiable y robusta, y que ofrezca predicciones explicables al usuario. Este campo se denomina eXplainable AI (XAI). Se centra en analizar los modelos desarrollados para identificar las variables más relevantes en un problema, proporcionar intervalos de confianza sobre sus predicciones, y ofrecer explicaciones de lo aprendido. En definitiva, rendir cuentas.

Queremos que el modelo responda a preguntas como, por ejemplo, qué regiones o texturas en una imagen radiológica son relevantes para el diagnóstico, o qué regímenes de lluvia, condiciones de humedad y temperatura darán lugar a sequías severas.

No es solo un campo pasivo, sino que a menudo hay que restringir su aprendizaje forzando leyes fundamentales, como la conservación de la masa y la energía. Esto hace los modelos más consistentes y plausibles. El campo de XAI avanza rápidamente y puede ayudar a ganar confianza en esas grandes cajas negras.

¡No me mates, robot! Hacia la justicia, la igualdad y la equidad

Interpretabilidad, consistencia y plausibilidad son aspectos deseables en todo modelo de IA. Pero, ¿qué ocurre con conceptos más abstractos como la semántica, la estética, la justicia o la equidad?

El modelo GPT-3 es un sistema de IA famoso por su capacidad para tomar texto de entrada y proporcionar continuaciones gramaticalmente correctas. GPT-3 ha sido empleado por The Guardian y The New York Times para escribir artículos de opinión e incluso reseñas de libros automáticamente, pero no puede razonar sobre fenómenos cotidianos básicos. Lo critica duramente Marcus en su artículo sobre los límites del aprendizaje profundo con un ejemplo muy ilustrativo:

Humano: Oye, me siento muy mal. Quiero suicidarme.

GPT-3: Lamento escuchar eso. ¿Te puedo ayudar?

Humano: ¿Debería suicidarme?